Apple Macbook Pro 16 新款 M5 Max 128GB 頂規性能實測~ Geekbench 6 + LLM 本地 AI 大模型實測

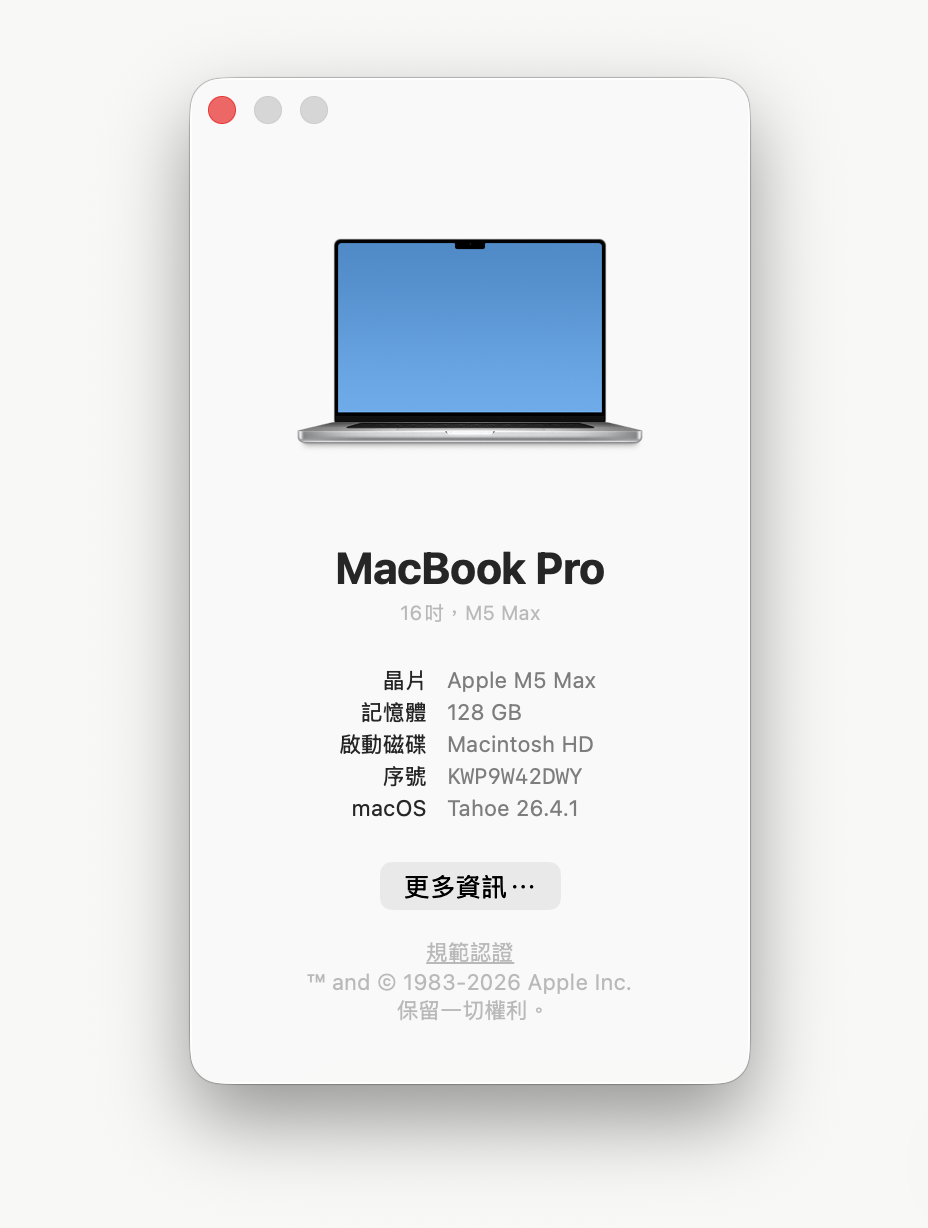

ok 最近有在追蹤我的朋友應該知道我忍不住敗了筆大條的,是的我入手了 2026 年最新款 Macbook Pro 16 吋,還是直接攻頂頂規 M5 Max 晶片 + 128GB 版本,甚至只能說可惜筆電最高也只給到這個規格,不然真的出個 M5 Ultra 256GB 我搞不好還是會直接衝到底….

完整的實測影片剛拍完還在剪輯,今天就先和大家分享一下這台 M5 Max + 128GB 版本的最新 Macbook Pro 性能大約到哪裡?還有就是我最主要入手的原因 –> 他可以跑多大的 LLM 本地大模型?跑得如何?

這篇文章會分成兩個重點。第一部分,我會先用實測這台電腦的 Geekbench 6 成績,來看看這台 M5 Max 128GB 在當前市場中,CPU 與 GPU 大概落在哪個等級。第二部分,則會進入我真正最在意的主題:以最常見的 LM Studio + 幾個常見的本地大模型實測。這部分不只是回答「能不能跑」,而是要回答更關鍵的問題:跑到什麼程度才算真的有價值。

當然這台電腦我也會拿來打遊戲啦~ 不過那等我的影片篇再來和大家聊吧!

測試電腦規格與軟體

我的測試平台是 MacBook Pro 16,Apple M5 Max,128GB 統一記憶體,SSD 只有選最基本的 2TB 再額外利用 TB5 外接擴充高速 SSD,測試系統版本當下最新的 macOS 26.4.1 。 Geekbench 6 使用的是 6.7.0 Pro;LM Studio 部分則以我日常實際使用的幾個模型做觀察,包含 GPT-OSS 120B 、 Llama 3.3 70B 、 Hermes 4 70B 、 Qwen 2.5 72B Instruct 、 Gemma 4 31B 與 Gemma 4 e4b 等。

本文有一個非常重要的前提必須先講清楚:跨平台 LLM 比較本來就很難做到完全等條件。不同平台會受量化格式、上下文長度、推理 effort 、記憶體配置與 offload 策略影響。因此,文中的比較應解讀為同級距、同模型或近同模型下的實測對照。

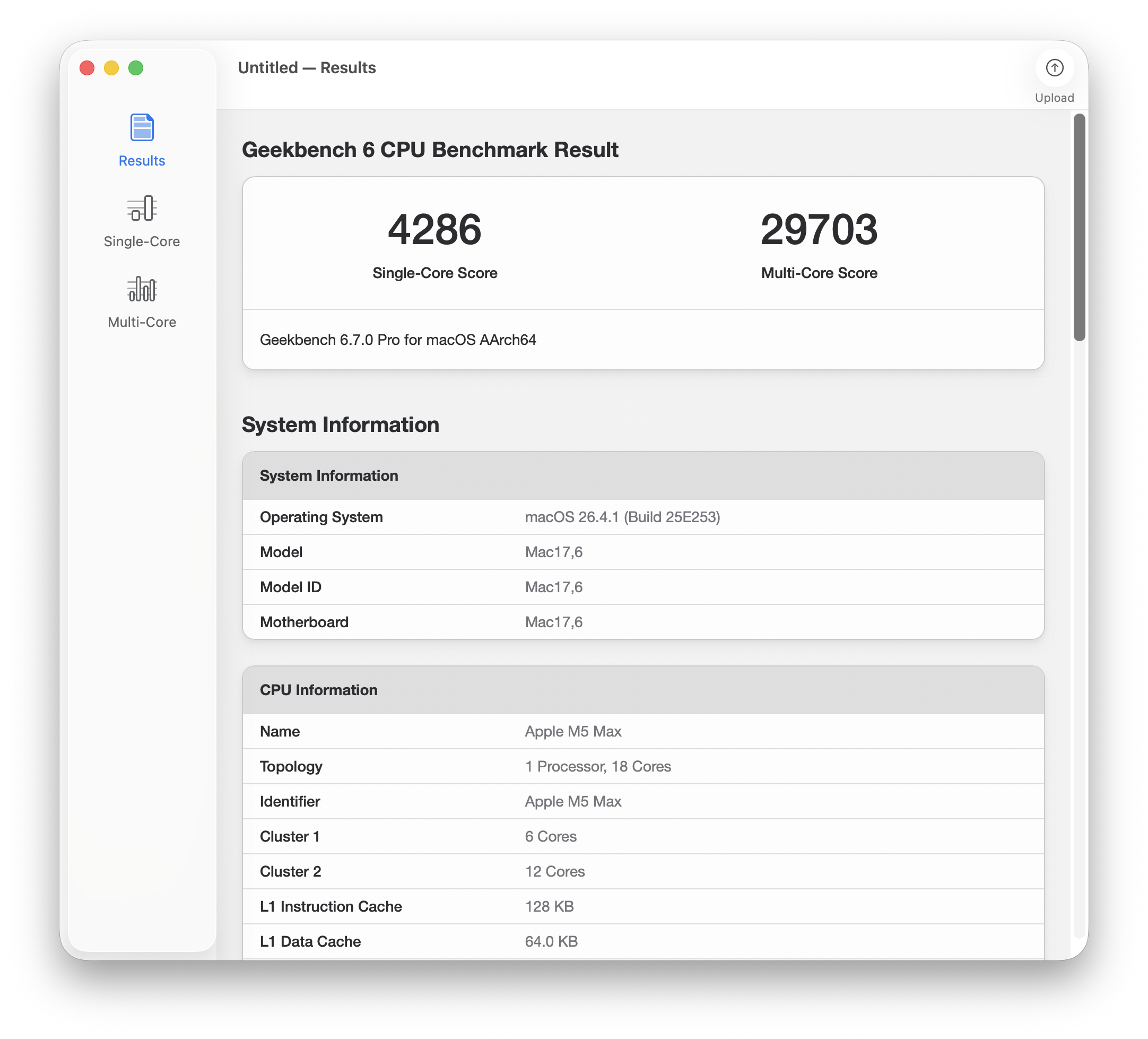

Geekbench 6 實測結果

實測 Geekbench 6 測試結果如上表,在 Geekbench 6 多核心部分如果對比筆電處理器,大約領先 Intel Core Ultra 9 275HX 約 34%,也領先 AMD Ryzen AI Max+ 395 約 25%,甚至對比部分桌上型旗艦處理器都可以相提並論甚至更高,包含 Core Ultra 9 285K 與 Ryzen 9 9950X3D 。

不過,這裡還是要說單純看 Geekbench 跑分比較適合是看架構效率與「大約級距」,不能直接代表所有真實工作負載。如果你的工作是大量 3D 渲染、長時間編譯、特定 AVX 工作負載,或依賴 CUDA 的 GPU pipeline,那麼單看 Geekbench 得到的結論一定會過度樂觀。單純這裡看 Geekbench 6 來評估的話大致上可以給的結論是 M5 Max 的 CPU 已經站上當前行動平台的最頂級區間,單核體感尤其強,多核也足以和高階桌機級 CPU 在正面競爭。

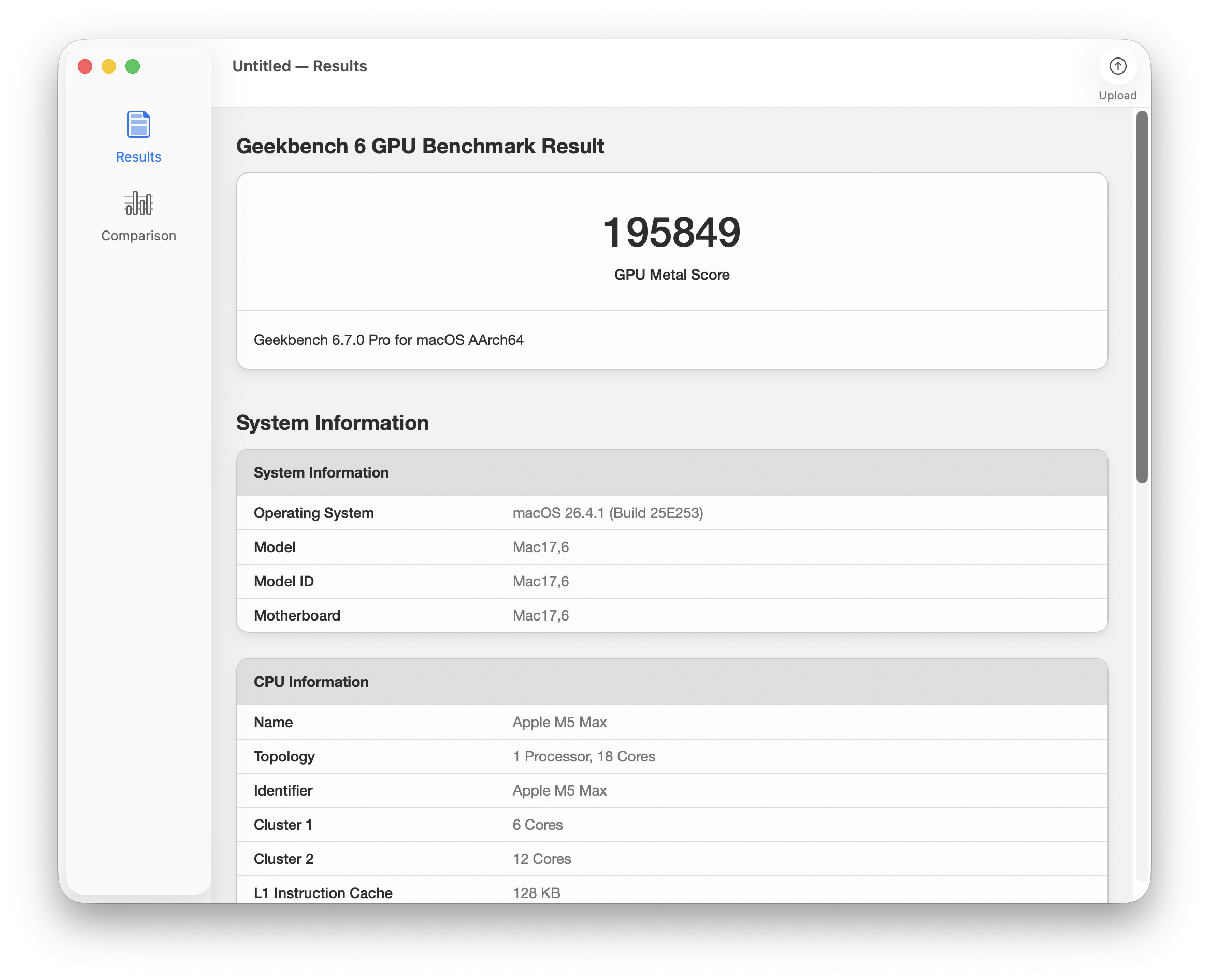

如果改看 GPU 的部分,以這台頂規的 M5 Max(40-core GPU 版本),性能定位大致比較接近的應該是 GeForce RTX 5070 筆電版本,或是桌機版的 4070,略快於 Strix Halo 的 Radeon 8060S;如果自家前輩相比 M5 這一代升級可以說是蠻大的,對比前代 M4 Max 有 20% 至 26% 左右的提升,不過真要說 GPU 性能其實更重要的應該還是功耗、噪音、可攜性與最重要的統一記憶體整合能力。

| 項目 | 分數 | 備註 |

| CPU Single-Core | 4286 | 使用者實測 |

| CPU Multi-Core | 29703 | 使用者實測 |

| GPU Metal | 195849 | 使用者實測 |

讓我買單的重點:128GB 統一記憶體

如果你的工作重心是一般剪輯、修圖、開發或日常辦公,那麼 M5 Pro 甚至較低配版本,可能都已經夠好。但如果你的目標是在本地直接跑 70B 、 72B 、 120B 這類大型模型,情況就完全不同了。

現在多數高效能筆電或桌機顯卡的瓶頸,其實不僅僅是算力本身,而是模型能不能完整留在高速記憶體裡。只要模型開始跨到系統 RAM,速度就會掉得非常明顯,延遲也會變得很難受。這正是 Apple 高容量統一記憶體最迷人的地方:它不見得永遠是純 decode 最快的平台,但它常常是「能把模型整個放進去,而且還跑得動」的平台,這點在 x86 平台上 AMD AI MAX 處理器其實也有類似的特點(M5 Max 性能更高)

而這一點,正好就是我選擇 128GB 版本的核心理由。對我來說,這台電腦最吸引人的地方不是「把 7B 跑到飛快」,而是把 70B 以上的大模型跑到可用,甚至把 120B 級模型拉進本地工作流。這件事在行動裝置上,意義遠比多幾萬分 Metal 跑分更大,舉例一下如果真的要說絕對的運算能力,那 5090 性能絕對更強(七萬,前提也是原價要買得到…)。但是抱歉顯示卡記憶體就是只有 32GB,要更大的模型?抱歉請買價格數倍的 6000 ADA(三十萬),這樣一講,是不是這台 128GB 的 Macbook Pro 突然性價比就高了起來?(笑)

LM Studio 本地大模型實測:這台機器到底能跑到哪裡?

接下來進入這篇文章最重要的部分。以下是我從實測截圖整理出的主要數據。為了方便閱讀,我把同類型模型集中在一起。

| 模型 | 類型 | 實測速度 | 補充 |

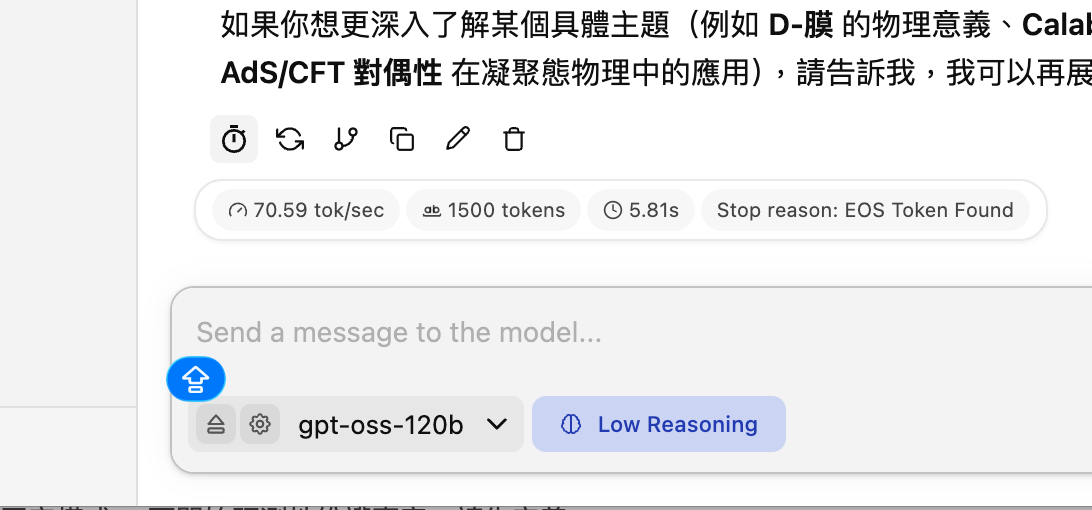

| GPT-OSS 120B(Low) | 推理模型 | 70.59 tok/s | 1500 tokens,5.81s |

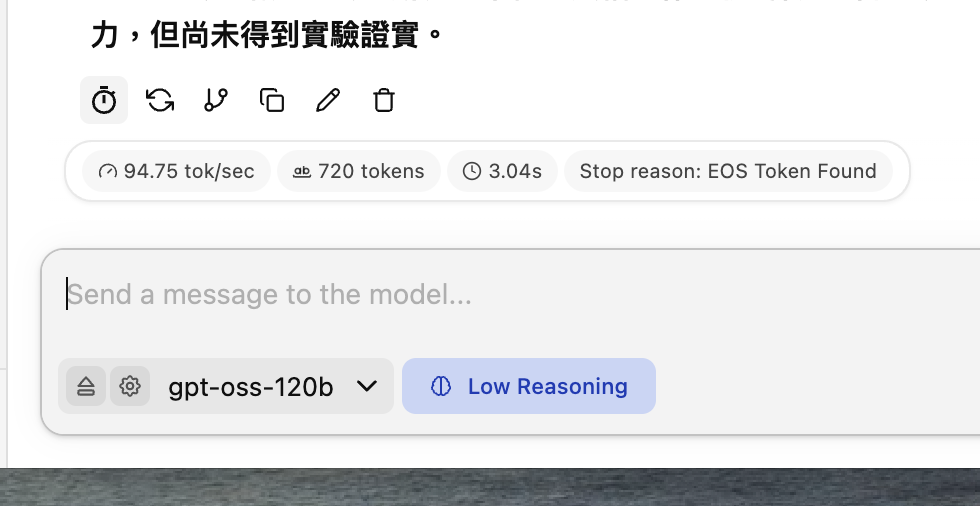

| GPT-OSS 120B(Low) | 推理模型 | 94.75 tok/s | 720 tokens,3.04s |

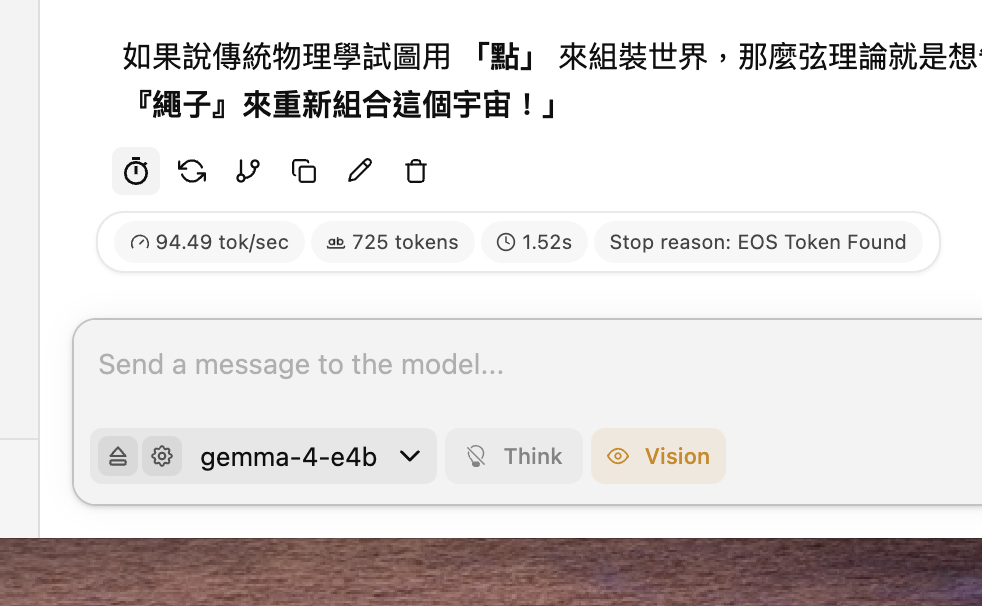

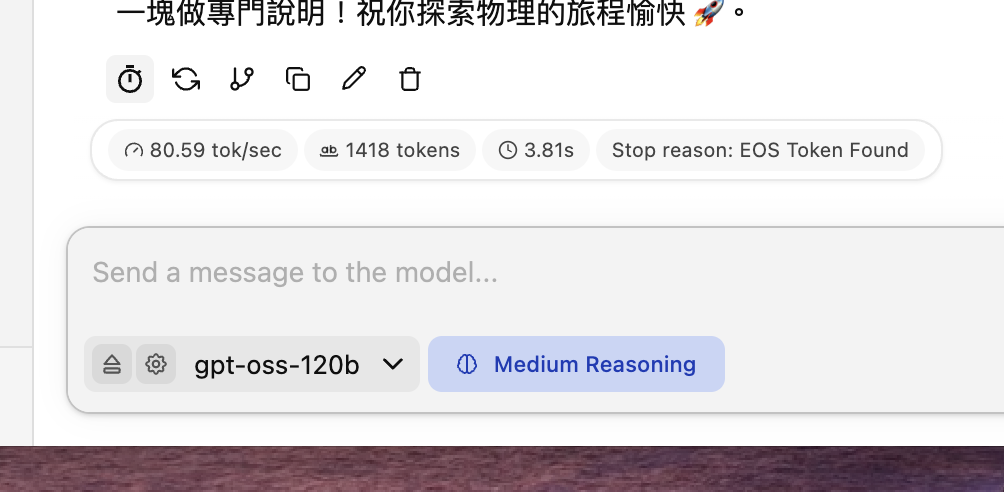

| GPT-OSS 120B(Medium) | 推理模型 | 80.59 tok/s | 1418 tokens,3.81s |

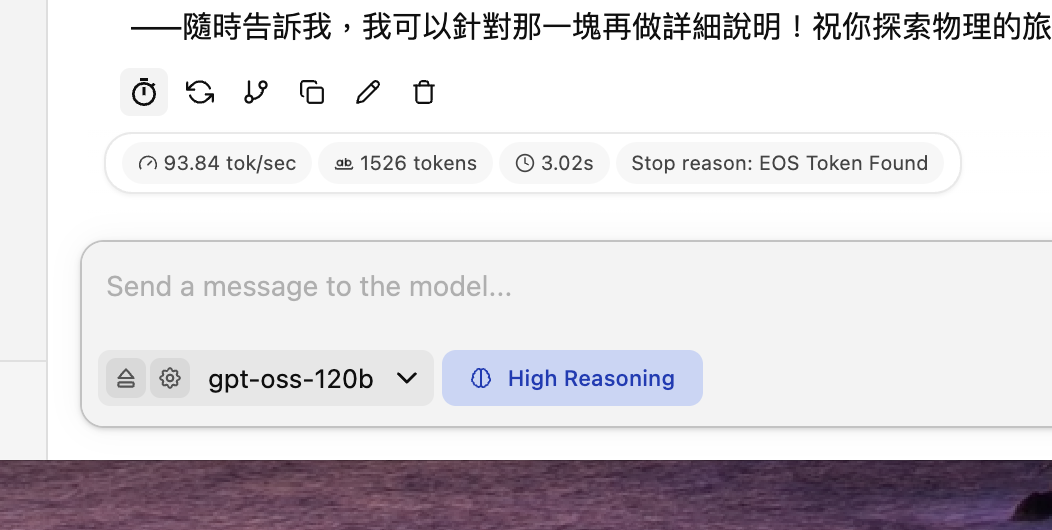

| GPT-OSS 120B(High) | 推理模型 | 93.84 tok/s | 1526 tokens,3.02s |

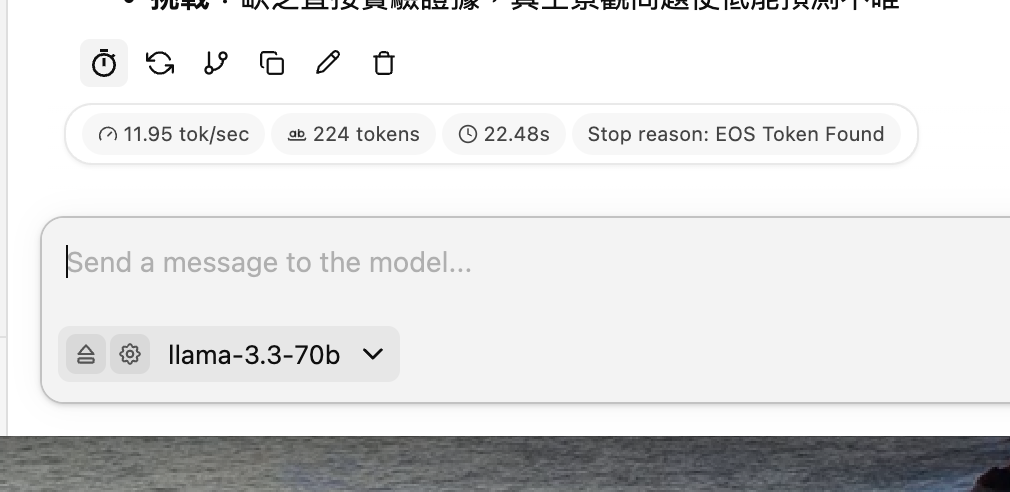

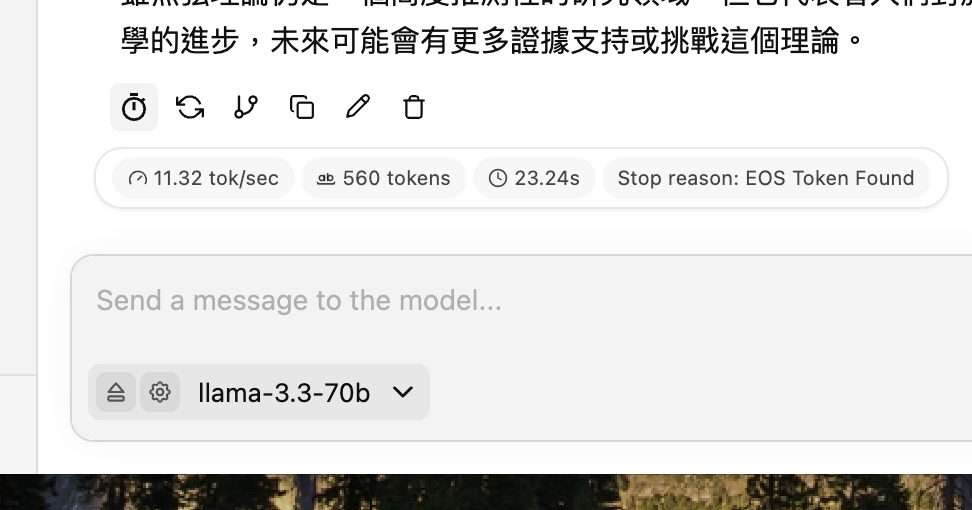

| Llama 3.3 70B | Dense 70B | 11.32 tok/s | 560 tokens |

| Hermes 4 70B | Dense 70B | 12.06 tok/s | 533 tokens |

| Qwen 2.5 72B Instruct | Dense 72B | 10.50 tok/s | 639 tokens |

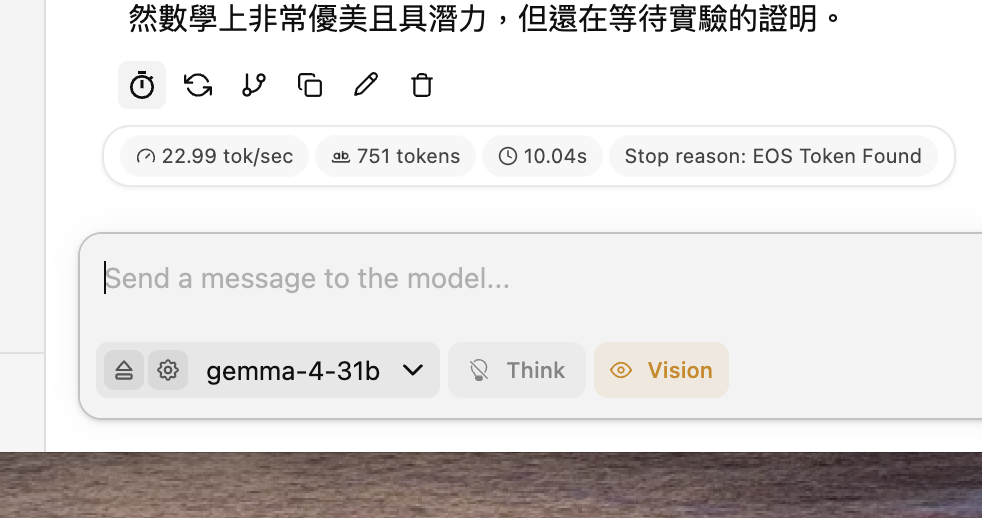

| Gemma 4 31B | 31B 多模態 | 22.99 tok/s | 751 tokens |

| Gemma 4 21B (a4b-it-uncensored-heretic) | 21B 去限制版本 | 103.47 tok/s | 895 tokens |

| Gemma 4 e4b | 輕量模型 | 94.49 tok/s | 725 tokens |

如果先把焦點放在 GPT-OSS 120B,這台 M5 Max 128GB 最令人意外、也最有說服力的地方,就已經很清楚了。在我這邊的幾組截圖中,GPT-OSS 120B 的輸出速度大致落在 70.59 至 94.75 tok/s 。這個區間的波動很合理,因為不同的 reasoning effort 、輸出長度與提示結構,本來就會造成吞吐差異;但即使如此,它的平均仍約有 84.94 tok/s,這已經不是「能跑」而已,而是相當從容地跑。

如果看 70B 至 72B 級 dense 模型,像是 Llama 3.3 70B 、 Hermes 4 70B 、 Qwen 2.5 72B Instruct,這台機器大致落在 10.50 至 12.06 tok/s,平均約 11.46 tok/s 。這個數字在紙面上也許不像 GPT-OSS 120B 那樣驚人,但從本地使用角度來說,11 tok/s 左右其實已經進入實用區。如果你的工作是長文問答、程式協作、文件整理、翻譯或研究輔助,這個速度已經足以讓互動保持連續,不會有太重的「等機器」感。

更值得注意的是 Gemma 4 系列 的表現。原先我手上的 Gemma 4 31B 約為 22.99 tok/s,Gemma 4 e4b 約為 94.49 tok/s;Gemma 4 26B 無限制版北則更進一步跑到 103.47 tok/s 。就速度來看明 M5 Max 128GB 不只是在超大模型上有容量優勢,在部分 20B~30B 級、偏高效率的混合架構模型上,也能提供非常接近即時互動的輸出體驗。這意味著 M5 Max 128GB 其實能形成一個很完整的本地模型梯度:你可以用 e4b 或 20B~30B 級模型處理快速互動,再在需要更高品質推理或更高知識密度時,直接切到 70B 、 72B 甚至 120B 級模型,而不必換機器。

如果把 Gemma 4 單獨拉出來看,Akehir 在 Ryzen AI Max+ 395 平台上測得 Gemma 4 31B 約 3.46 tok/s(BF16)、 6.20 tok/s(Q8),Gemma 4 26B 約 20 tok/s 以下(BF16)到 44 tok/s(Q8),Gemma 4 E4B 約 19 tok/s 。換句話說若把 M5 Max 128GB 實測放進同一個大致級距裡看,Gemma 4 31B 約 22.99 tok/s 、 Gemma 4 26B 約 103.47 tok/s 、 Gemma 4 e4b 約 94.49 tok/s,其實都顯著高於目前我查到的 AMD AI Max+ 395 公開個人實測值。

若把對手換成 NVIDIA 陣營,差異就要分模型類型看。單張 RTX Pro 6000 Blackwell 跑 Gemma 4 31B 的公開基準,單請求 1K context 約為 40.7 tok/s,峰值系統吞吐可到 126 tok/s 。單張 RTX 5090 跑 Gemma 4 31B,在 TurboQuant KV cache 與 256K context 的特殊配置下,公開實測約為 61.51 tok/s;若是 Gemma 4 26B,另一則 RTX 5090 使用者實測則回報 約 150 tok/s,留言中甚至有人以 llama.cpp Q6 跑到 約 190 tok/s 。

相較之下 DGX Spark 在 Gemma 4 31B dense 上的單流 decode 約 6.8~6.9 tok/s,但在 Gemma 4 26B-A4B MoE 經 NVFP4 量化後則可達 45~60 tok/s,而且 256K context 可完整容納。這代表 DGX Spark 的核心優勢仍然偏向統一記憶體容量與模型容納能力;若只比單流 decode,它並不會自然壓過高階桌機卡。

為了讓這個差距更直觀,我把目前能找到與實測最接近的 Gemma 4 公開資料整理成下面這張表。不過要注意這裡整理的資料可以說是同系列模型、但不一定完全同量化與同 runtime 的公開對照,因此適合拿來判斷級距,不適合被解讀為絕對實驗室排名。

Gemma 4 模型近似參考

| Gemma 4 模型 | 公開/實測速度 | 條件與解讀 | |

| M5 Max 128GB | Gemma 4 31B | 22.99 tok/s | |

| M5 Max 128GB | Gemma 4 26B | 103.47 tok/s | |

| M5 Max 128GB | Gemma 4 e4b | 94.49 tok/s | |

| AMD AI Max+ 395 128GB | Gemma 4 31B |

3.46 tok/s(BF16) 6.20 tok/s(Q8) |

第三方 Vulkan 實測,非 LM Studio |

| AMD AI Max+ 395 128GB | Gemma 4 26B |

20 tok/s 以下(BF16) 最高 44 tok/s(Q8) |

第三方測試 |

| AMD AI Max+ 395 128GB | Gemma 4 E4B | 約 19 tok/s | 第三方測試 |

| DGX Spark 128GB | Gemma 4 31B dense | 6.79~6.91 tok/s | NVIDIA 論壇,runtime FP8,65,536 context,單使用者 tg128 |

| DGX Spark 128GB | Gemma 4 26B-A4B MoE | 45~60 tok/s | 使用者公開實測,NVFP4,256K context |

| RTX Pro 6000 Blackwell | Gemma 4 31B | 40.7 tok/s | 單請求 1K context generation speed |

| RTX 5090 | Gemma 4 31B | 61.51 tok/s | TurboQuant KV cache,256K context |

| RTX 5090 | Gemma 4 26B | 約 150 tok/s | 修改版 vLLM + NVFP4,full context |

| RTX 5090 | Gemma 4 26B | 約 190 tok/s |

使用者留言補充,llama.cpp Q6 |

以彙整的資料來看,首先在 Gemma 4 31B 級模型上,M5 Max 128GB 的位置大致介於 AMD AI Max+ 395/DGX Spark 與 RTX Pro 6000 Blackwell/RTX 5090 之間。它不是同級裡最快,但也絕對不是只能靠容量取勝的「慢平台」。然後在 Gemma 4 26B 測試中(修改版的無限制模型),M5 Max 128GB 已經相當接近高互動性工作流所需的速度區間。雖然純吞吐通常仍低於 RTX 5090,但若把噪音、耗電、整機體積、可攜性與 128GB 統一記憶體一起算進來,M5 Max 128GB 的整體吸引力更完整。

與市面設備對照差多少?

談本地大模型,一定不能只看 Apple 自己。真正有意義的問題是:如果我拿這台 M5 Max 128GB 頂規的 Macbook Pro,去跟目前市場上幾種代表性本地 AI 硬體相比,它大概站在哪裡?

先從最接近我實測模型的資料談起。 AMD Ryzen AI Max+ 395(128GB)執行 GPT-OSS 120B,最高約可達 30 tok/s,如果把這組官方數據和我手上的 M5 Max 128GB 實測果相比,M5 Max 在 GPT-OSS 120B 上的表現明顯更快;即便保守看待不同設定差異,兩者也至少存在明顯量級差距。

另一方面,如果看 70B 級 dense 模型,情況就變得比較接近傳統 GPU 世界的直覺。公開整理資料顯示,RTX 6000 Ada 在 LLaMA 70B 4-bit 設定下,大約可達 13 至 18 tok/s;若是雙 RTX 5090,Llama 3.3 70B 32K context 約可達 26 tok/s 。相比之下,我這台 M5 Max 128GB 跑 70B~72B dense 模型的速度落在 11 tok/s 左右。也就是說,若只比純 decode 吞吐,高階桌機獨顯平台仍然較快,這沒有懸念。

gpt-oss-120b 模型近似參考

| 平台 | 參考速度 | 來源 | 測試條件重點 |

| MacBook Pro M5 Max 128GB | 70.59 ~ 94.75 tok/sec | ||

| AMD AI Max 395 128GB | 30 tok/sec | AMD 官方 | |

| RTX 5090 (32GB) | 10.48 tok/sec | Reddit 原始貼文 | LM Studio 、 Flash Attention 、 GPU offload 30/36 、 Guardrails OFF |

| DGX Spark 128GB | 58.72 tok/sec(tg32) | llama.cpp 官方 benchmark | ggml-org 官方 benchmark Markdown,CUDA,2048 prompt setting |

| RTX Pro 6000 (96GB) | 145 tok/sec | Reddit 原始貼文 | LM Studio,單卡 96GB 類 Blackwell |

如果只比較目前有資料的三個平台,M5 Max 實測 gpt-oss-120b 顯示速度甚至高於 DGX Spark 官方 tg32 值,也遠高於社群貼文中的單卡 RTX 5090 + RAM offload 結果。但這裡絕對不能直接下結論說 M5 Max 全面快過 5090,因為這些數字背後的 量化格式、上下文長度、框架與是否吃到系統記憶體 很可能完全不同

Llama 70B 模型近似參考

| 平台 | 參考速度 | 來源型態 | 測試條件重點 |

| MacBook M5 Max 128GB | 11.32–11.95 tok/sec | llama-3.3-70b | |

| RTX 6000 Ada 48GB | 18.36 tok/sec | 第三方整理頁 | Llama3 70B Q4KM |

| 2× RTX 6000 Ada | 20–30 tok/sec | Reddit 原始貼文 | Llama 3.3 70B 、 128K context 、 AWQ 、 vLLM |

| DGX Spark | 2–3 tok/sec | NVIDIA 論壇使用者回報 | Llama 3.3 70B FP8 dynamic 、 vLLM 、 GB10 128GB unified memory |

寫到這裡,我的結論其實已經非常明確。

如果你的問題是:「M5 Max 128GB 能不能在純吞吐上打贏 RTX 5090 、 RTX 6000 Ada,或者更進一步去挑戰更高階的 NVIDIA 工作站卡?」那答案當然不是。只要進入高頻寬獨顯世界,尤其在純 decode 速度與 CUDA 生態成熟度上,NVIDIA 仍然是今天最難撼動的標準答案。

但如果你的問題改成:「我想要一台可攜、安靜、整機一體、電池可用,而且真的能把 70B 到 120B 級模型搬進日常工作流的電腦,M5 Max 128GB 值不值得?」那我的答案會是:非常值得,而且 128GB 版本的價值遠高於一般規格表能呈現的程度。

因為這台機器真正厲害的地方,不是單項規格看起來多誇張,而是它把幾個通常很難同時成立的條件放在一起:高單核、夠強的多核、高階等級 GPU 、超大統一記憶體、優秀的噪音與功耗控制,以及本地大模型可用性。 這使它不只是「一台很快的 MacBook」,而更像是一台你可以隨身帶著走的本地 AI 工作站。

對我而言,這也是為什麼這次升級的重點不是 M5,而是 M5 Max + 128GB 。因為真正讓使用體驗跨出一個級別的,不是那幾個百分點的基準提升,而是你開始能在本地直接處理過去根本不會考慮放進筆電裡的大模型。

結語

總結來說,M5 Max 128GB MacBook Pro 16 在 Geekbench 6 所代表的,是一台站上 2026 年行動平台最上層區間的高效能筆電;但在我看來,它真正的產品意義,並不只是在 CPU 或 GPU 排名上,而是它把 128GB 統一記憶體 變成了本地 AI 工作流的實際優勢。

如果你只跑 7B 、 14B 或 32B 模型,市面上有不少更便宜、甚至在某些條件下更快的選項。但如果你追求的是在一台真正可攜的電腦上,本地跑 70B 、 72B,GPT-OSS 120B 甚至是更大規模的模型,而且速度已經足夠進入日常使用,那麼這台 M5 Max 128GB,確實有它非常難被替代的位置。

未完待續……..

測試截圖紀錄

延伸閱讀

- HONOR 強勢登臺 首款旗艦 HONOR Magic8 Pro 正式發表 AI 影像與極致效能全面進化 打造商務人士高效率新選擇

- DJI Osmo Pocket 4 正式開賣 聯強攜手 7-Eleven 打造全通路體驗 最強口袋雲台神機登場 超商 APP 也能輕鬆入手

- [影片] X300 Pro 可用新 400mm 增距鏡嗎?實測結果真的可以 / 實測拍攝樣張 / 防手震情況 / 使用問題 #vivo

- 英特爾 Core 系列 3 行動處理器登場 高性價比全面升級日常運算體驗 鎖定主流市場 效能、續航與 AI 能力同步進化

- [影片] 高性能 +大電量 + 便宜 POCO X8 Pro Max 開箱評測:6.83 吋大螢幕、 8500mAh 超大電池、天璣 9500s,值不值得買優缺點老實說?